京都大学工学部情報学科には計算機科学コースと数理工学コースがありますが,弊研究室の属する後者は今年60周年記念を迎えます.2019年10月には記念出版や記念シンポジウムが予定されています.詳細は下記URLを参照してください.

2019年に数理工学は60周年を迎えます

https://www.suurikai.net

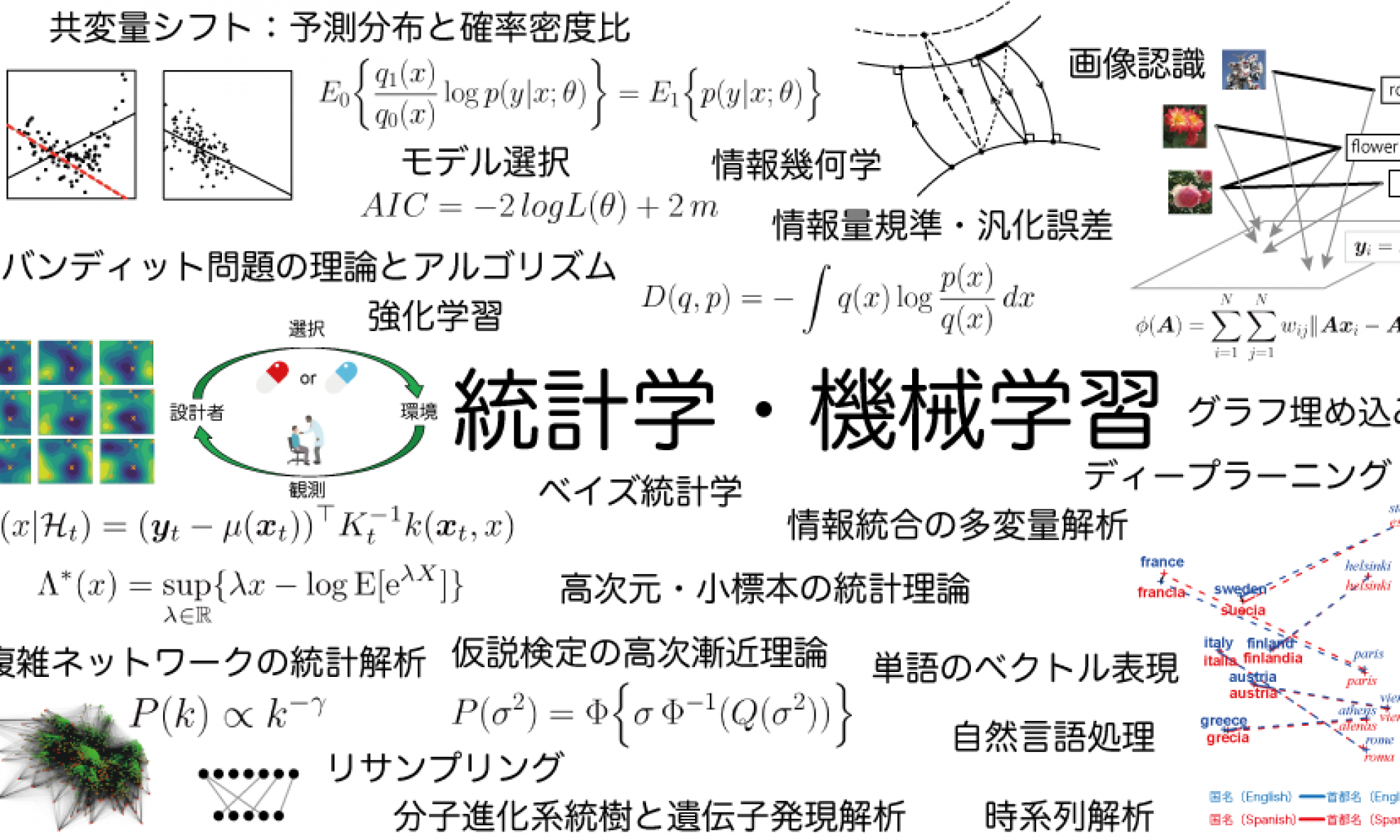

「数理工学」の名を冠する専攻・学科・コースの英訳は,Applied Mathematics and Physics, Mathematical Engineering, Mathematical Sciencesと様々あることからわかるように,数理工学で行われている研究の内容は一律ではありません.最近では数理工学と関わりが深い人工知能やデータサイエンスが大きく発展していますが,数理工学は工学・社会・人間・経済・自然現象など森羅万象を扱う工学・数学・情報学にまたがる学際的分野とされることが多いようです.

京都大学の数理工学科は1959年に誕生し,それより少し前に誕生した東京大学の数理工学コースと並んで日本の数理工学を牽引してきました.2019年は数理工学科が誕生して60周年にあたります.研究者・学生等として京都大学の数理工学科・数理工学コースを担当する研究室に所属したことがある方々だけでなく広く数理工学に関心のある方々を対象として,ここに「数理工学誕生60周年記念ホームページ」を開設しました.

数理会幹事 中村佳正

ちなみに東京大学の数理工学コースは1951年設立のようです.詳細は次の東大のサイト「理念と歴史(数理情報工学)」で説明されています.